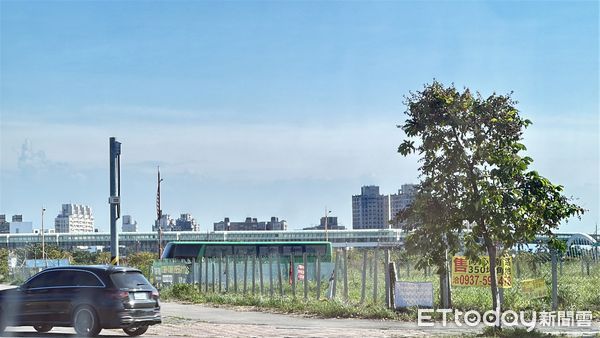

▲面對房市景氣反轉,台中仍有不少建商預計在2025年推出破百億元案量,且不約而同將強攻換屋族。(圖/記者陳筱惠攝)

記者陳筱惠/台中報導

台中上市建商順天建設(5525)面對房市景氣反轉,仍預計在2025年推出百億案量,另外2024年手握200億元案量的國聚建設,2025年也將有百億元案量登場,對於明年景氣走向,開發商不約而同將強攻換屋族。

聖誕節前夕,台中順天環匯酒店、順天建設連續7年替一粒麥課輔班師生舉辦慈善耶誕餐會,據了解,順天建設2025年第一季將推出13期昌明段新案「Mr.L」總銷達40億元,市場推估開價預計8字頭。

▲順天建設總經理林丙申(中)透露2025年將持續深耕台中重劃區市場,13、14期推案全面以自住、換屋族為主。(圖/記者陳筱惠攝)

在活動中順天建設總經理林丙申也透露:「該地點生活機能與公園綠地條件優良,又有捷運南來北往,地點在13期重劃區,主客群為高資產換屋族。2025年將持續深耕台中重劃區市場,13、14期推案全面以自住、換屋族為主。」

除了「Mr.L」,順天建設接下來則還有南台中永豐段新案,總銷42億元,同時也押寶北台中包含14期仁平段新案、總銷36億元,3案總銷達118億元,另,順天建設還有北市信義兒福公辦都更案,期待2025年可取得建照,2026年若順利推案總銷將達75億元。

林丙申說:「目前新案規劃都會朝向45坪左右物件,在經濟結構波動下,市場出現兩極化,但不變的是自用市場當道,公司將鎖定換屋族,提供高奢訂製款換屋族產品。」

▲國聚建設位於七期原展華婚宴會館案,預計2025年將推出2~4房產品,市場預估開價將登上8字頭。(圖/記者陳筱惠攝)

另外,在2024年推出4大案的國聚建設,佈局包含五期「國聚之穎」、十三期中山醫「國聚之尚」、水湳中央公園特區 「國聚之瑑」、南屯區精科「國聚之築」,4案總銷突破200億元。

國聚建設副總經理卓慶能表示:「2025年將有福田路新案、七期『展華』案,台中的開發商現在都將目標轉向拼自用,2025年將是考驗建設公司的底蘊的時刻,而目前首購族能接受的預算總價約落在1500~2000萬元內,這對目前市場也是一個考驗。」

其中七期「展華」案預估將推出2~4房產品,因地點區段條件佳,市場預估開價也將登上8字頭。

標題:台中2大建商2025推案量衝百億 七期婚宴會館改建估賣8字頭

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。