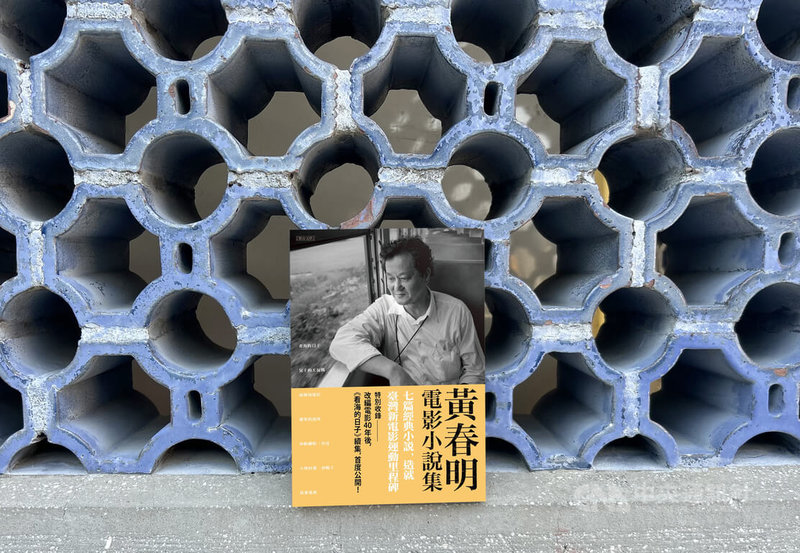

(中央社記者邱祖胤台北24日電)作家黃春明有多部小說被改拍成電影,其中「看海的日子」更受到大眾喜愛及肯定,時隔40年續集電影劇本首度公開,並收錄在重新出版的「黃春明電影小說集」中。

小說集收錄7篇經典小說,包括「看海的日子」、「兒子的大玩偶」、「兩個油漆匠」、「蘋果的滋味」、「莎喲娜啦.再見」、「小琪的那一頂帽子」、「我愛瑪莉」。

根據聯合文學發布新書資訊,1980年代台灣電影界掀起一股風起雲湧的「新浪潮」電影運動,一群年輕新銳電影導演從文學作品汲取靈感,此一時期最為重要的便是黃春明的小說。

新書資訊指出,黃春明擅長將底層人物的悲哀與喜樂、既卑微又尊嚴的眾生相,活靈活現地寫出來。如「看海的日子」刻劃委身青樓卻意志堅強、不向命運低頭的妓女白梅;「兒子的大玩偶」裡孩子看到父親真面目竟認不得而大哭的荒謬與哀傷;「兩個油漆匠」則揭示了原住民族和老兵在現代化都市底下的扞格不適。

此外,黃春明亦有許多作品披露台灣在美日兩國經濟殖民下的社會圖像,如「蘋果的滋味」裡因車禍失去謀生能力的工人阿發一家,對咀嚼到洋人贈予的蘋果雀躍不已;「莎喲娜啦.再見」中被迫帶日本人到礁溪去嫖自己同胞姊妹的黃君;「小琪的那一頂帽子」、「我愛瑪莉」則描述小人物在工商社會下為了生存掙扎遭受經濟文化殖民的卑屈。

首度公開的「看海的日子續集電影劇本」,則描寫妓女白梅借種生下私生子,一心將他栽培長大成人,她不相信像她這樣出身、欠缺當一個母親條件的女性,孩子的將來就沒有希望。(編輯:李亨山)1131224

標題:黃春明電影小說集重出 看海的日子續集劇本首公開

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。