經濟部統計,2024年受惠AI伺服器、人工智慧等新興科技應用需求擴增,以及業者切入低軌供應鏈,推升印刷板需求,1~9月產值年增10.9%,全年可望重返正成長軌道。

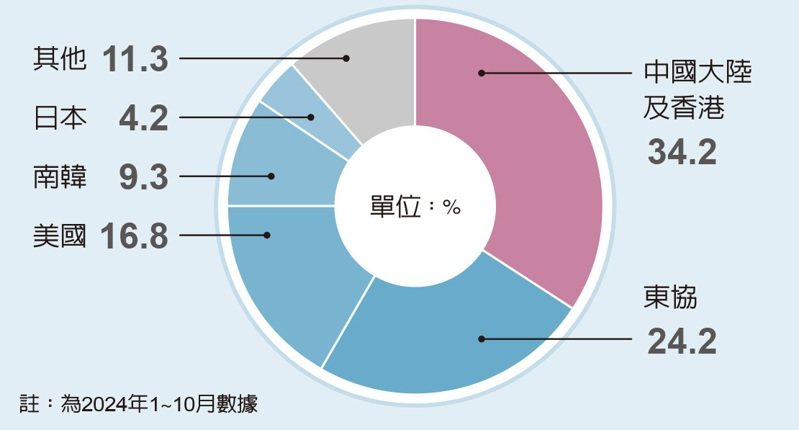

前十月出口41億美元 陸港佔大宗

海關出口統計,2024年1~10月我國印刷電路板業出口41.4億美元,年增0.3%。若按出口地區別觀察,今年前十月我國印刷電路板業出口以中國大陸及香港佔34.2%居首,其次為東協佔24.2%,美國佔16.8%居第三。

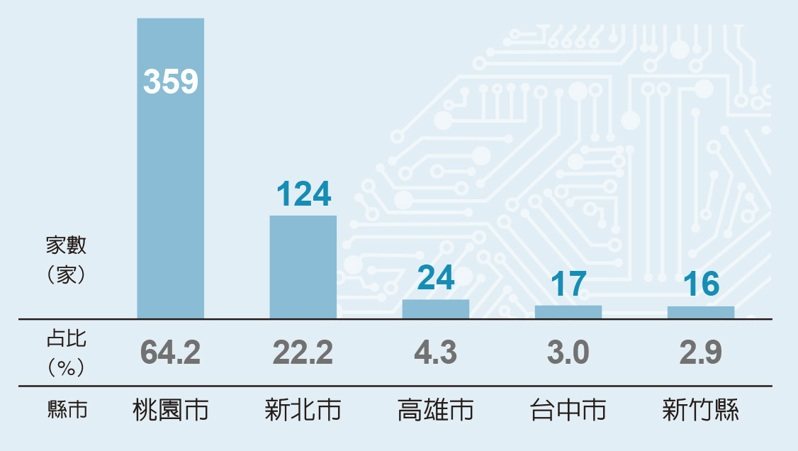

全台廠商共559家 近九成在北台灣

依2023年工廠校正及營運調查統計初步報告,2023年我國印刷電路板業廠商計559家,以員工人數200人以下之中小型企業為主,約佔八成四,其中桃園市359家(佔64.2%)最多,新北市124家(佔22.2%)居次,近九成業者集中在北台灣。

標題:每周一勢/印刷電路板全年產值可望重返成長

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。