2024年12月26日,海鷗表70周年暨中國制表70年新品發布會於天津成功舉辦,這是品牌自成立以來,堅持自主研發和探索創新所取得的輝煌成就的縮影,亦是對中國制表業70年風雨兼程、探索前行的崇高致敬。

海鷗表,這個誕生於天津,开創了中國制表事業的民族品牌,從機芯的研發到腕表的生產,從工藝的傳承到設計的創新,以掌握核心技術優勢爲底氣,以弘揚中國優秀文化爲己任,始終引領着中國制表業的方向,改寫着世界制表業的格局。

發布會現場,天津市政府領導,中國鐘表協會理事長,復星國際執行董事、復星國際執行總裁、豫園股份董事長黃震先生,漢辰表業CEO、海鷗表業董事長兼總經理徐創越先生蒞臨出席並致辭,共同慶祝這一歷史時刻。同時,品牌重磅發布多款全新力作,探索高級制表與復雜功能的全新表達,獻禮70年崢嶸歲月的波瀾壯闊與榮耀光輝。肩負“我有一顆中國芯”的豪邁使命,海鷗表將繼續在中國制表的新徵程上展翅翱翔。

海鷗表70周年暨中國制表70年新品發布會現場

漢辰表業CEO、海鷗表業董事長兼總經理徐創越先生致辭並發布新品

以探索之名

展開全文

探索精神,是海鷗表一路前進的基石,這份對於探索的執着,從品牌誕生之初一直傳承至今,也在海鷗表的各個系列產品中做出了全方位的詮釋。縱觀品牌70年的探索之路,皆是以一顆勇敢探索之心,創造着屬於海鷗表和中國制表的歷史。品牌成立伊始,是中國制表零基礎的年代,在各種資源技術極其匱乏的條件下,獨立探索,攻堅克難,自主研發出中國第一枚腕表“五星”表;在此之後,海鷗表繼續探索,在前人打下的夯實基礎下,精益求精,研發出多款自產機芯,掌握了核心技術優勢;如今的海鷗,不忘初心,在弘揚東方美學與精進制表工藝的目標道路上,正加快探索的腳步,懷揣70年探索之路所收獲的經驗與實力,突破傳統理念的限制,賦予高級制表全新定義,助力中國制表彎道超車,以強大的身姿登上世界制表的舞台。

海鷗表70周年暨中國制表70年主題展覽

“五星”表復刻款

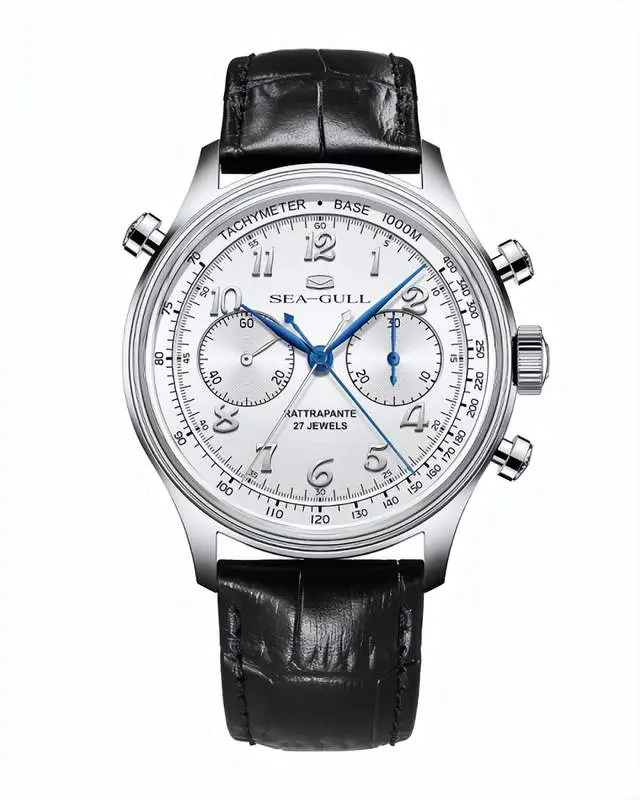

飛行系列雙秒追針計時碼表

時光追溯至1961年,彼時的天津手表廠(現海鷗表)接到一輕部下達的代號爲“304”的爲中國空軍打造航空計時碼表的神聖任務,旨在擺脫對進口計時碼表的依賴。通過夜以繼日的大量研究和鍥而不舍的探索,天津手表廠成功完成了ST3機芯的研發,开創了中國空軍飛行碼表機芯從0到1的歷史性飛躍。1963年底,經過堅持不懈的努力和嘗試,中國第一枚航空計時碼表震撼問世,這便是後來在世界制表舞台上聲名遠揚的“1963”。

此次,海鷗表重磅推出飛行系列雙秒追針計時碼表,探索極致計時功能,傳承304的光榮使命。雙秒追針功能即通過10點位按鈕實現獨立秒針暫停記錄,同時主計時秒針繼續運行,滿足精准記錄兩個時間點的需求。表殼整體使用鈦材質,輕盈耐用。外觀則延續飛行系列的經典造型設計,營造更強的視覺層次感。細節工藝上凝聚了海鷗制表人的卓越技藝和匠心獨運,這款時計不僅是一件精密儀器,更是制表藝術的經典之作,完美結合了創新工藝與奢華美感。

海鷗表飛行系列雙秒追針計時碼表

大師海鷗系列“鬥轉星移”中華天文歷法陀飛輪機械腕表

陀飛輪是鐘表三大復雜功能之一,長期以來作爲高級制表的核心技術一直被瑞士等歐洲國家所掌控,海鷗表從2002年开始自主研發,突破技術壁壘,制造出了具有國際水平的陀飛輪腕表。大師海鷗系列“鬥轉星移”中華天文歷法陀飛輪機械腕表,是獻禮品牌以及中國制表業70周年華誕的又一重磅之作,用圖形的方式實現中華歷法的顯示,觀象授時,探索宇宙與時間的奧祕。

腕表靈感源自蘇州天文石刻圖,這是世界上現存最古老的根據實測繪制的全天石刻星圖,揭示了古人對宇宙運行奧祕的精確解讀。腕表通過兩個以不同速度同軸旋轉的盤實現“鬥轉星移”,下方爲“北鬥盤”,上方爲“時辰盤”,中心爲北極星,北鬥盤每年逆時針旋轉366圈,盤上的指針指示時辰;其上的時辰盤每年逆時針旋轉一圈,盤上的指針指示二十四節氣。北鬥七星每日優雅旋轉,完美呼應二十四節氣與十二時辰的精妙輪替,融合傳統文化與頂尖制表技藝,匠心呈現宇宙與時間的和諧之美。

海鷗表大師海鷗系列“鬥轉星移”中華天文歷法陀飛輪機械腕表

大師海鷗系列“三足金烏”三問報時金雕動偶腕表

三問報時作爲高級制表的另一項復雜功能,同樣由海鷗表的制表師們自主攻克,於2007年成功研制出三問機芯。同時,海鷗制表師們圍繞非遺傳承技術,聯手國家級非遺大師們共同打造中國東方美學的高級腕表之作。金雕工藝是一項難度極高的手工技藝,其珍貴之處不僅在於創作材質的貴重,更在於稀缺的雕刻手法和藝術造詣。雕刻師需在方寸大小的篇幅裏,刻畫出立體生動而又精細考究的圖案,其復雜程度可想而知,鮮有制表品牌可以獨立做到。

大師海鷗系列全新發布的“三足金烏”三問報時金雕動偶腕表由中國金雕工藝大師梅花老師匠心打造,以《山海經》《太陽神鳥》等神話爲靈感基礎,探索東方美學的現代表達。工藝大師們通過精細雕刻工具將復雜的圖案或紋理雕刻出來,呈現出極具立體感和層次感的藝術效果,盡顯中華文化之美。搭載自主研發三問機芯,通過按動滑杆按鈕觸發報時功能,展現精密機械工藝與東方手工藝術的完美結合。三足金烏翅膀隨報時展开,融合機械與藝術,匠心與趣味兼具。不僅增添了腕表的動態美感,也賦予其更多互動性和收藏價值。

“三足金烏”作爲中國古代神話中象徵光明、溫暖與希望的太陽神鳥,其出現往往預示着好運連連、吉祥如意。因此,這款腕表不僅是精湛工藝的結晶,更是寓意吉祥的護身符,佩戴者仿佛能與古老神話中的智慧與力量建立起微妙的聯結,感受到源自遠古的神祕庇佑與無限好運。

海鷗表大師海鷗系列“三足金烏”三問報時金雕動偶腕表

大師海鷗系列“龍首磐音”陀飛輪、萬年歷、三問三合一機械腕表

海鷗表作爲國表的先鋒,真正向高級制表行業的頂峰衝刺,打破瑞士等歐洲國家的技術壟斷,當屬2009年品牌決定試制“陀飛輪、萬年歷、三問”三大復雜功能合一的超復雜腕表。隨着海鷗表首個自主研發的“三合一”超級復雜機械機芯ST9250的橫空出世,以及在2010年巴塞爾鐘表展的驚豔亮相,在全球制表行業引起了軒然大波。自此一役,海鷗表憑借一己之力提高了國產腕表的技術水平和市場競爭力,成功打破了瑞士對大復雜機芯技術的壟斷,爲中國的高端腕表开發鋪平了道路。

此次,品牌煥新推出的“龍首磐音”三合一機械腕表,爲這款超復雜功能腕表賦予全新的設計理念,探索對復雜功能的創新演繹。磐是一種石制樂器,其在遠古時期曾被賦予了高貴而神聖的使命,它與鐘類樂器在一起被稱之爲“金石之音”。腕表在三問報時功能上採用這一中國傳統樂器與現代手表的融合設計,讓樂器功能與機芯功能相得益彰。表盤上的紋理元素採用金沙遺址“銅龍首形器”進行設計,盤面字體取自小篆,呈現中國文化中博大精深的美學造詣。機芯集435個精細零件於一體,在有限的空間內各個功能組件均需重新設計安置,其復雜的機械邏輯關系,代表着世界制表業最頂級的技術和工藝,海鷗表是中國唯一攻克此難題的腕表品牌。

海鷗表大師海鷗系列“龍首磐音”陀飛輪、萬年歷、三問三合一機械腕表

海鷗表70周年,亦是中國制表七十載,這是一個值得銘記的時刻,也是一個全新的起點。未來,作爲國表先驅的海鷗表,將繼續秉持探索初心,以自主創新研發斬獲更多的“第一”,引領中國制表業邁向新的裏程碑,在世界制表舞台上綻放更持續耀眼的光芒,在人類計時文明的版圖上留下醒目的足跡。

關於海鷗表

海鷗表始創於1955年,品牌源自中國第一枚腕表“五星表”,是中國制表業的开創者和引領者。品牌成立以來,始終堅持自主創新研發,致力於高品質機芯的制造與中國原創機械腕表的研發生產。在追求創新的道路上從未停息,持續自研推出陀飛輪、問表、萬年歷等復雜結構機械表,在全球腕表行業格局中作爲中國專業制表品牌的代表,被譽爲“中國機械腕表集大成者”。

走過近70載的歷程,海鷗表歷經時代變化,陪伴數代中國人的時光,始終參與並見證中國時計的發展,專業記錄中國時間。

標題:以探索之名:海鷗表70周年暨中國制表70年新品發布會

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。