「2025年臺北最High新年城」跨年晚會圓滿落幕,主舞台集結超過15組歌手、團體接力演出,獨家卡司也是全台最多!倒數時刻由臺北市長蔣萬安攜手4位傑出運動選手登台,與民眾一同觀賞台北101絢麗煙火大秀,施放長達6分鐘,更被網友大讚是史上最美,吸引超過22萬人次齊聚台北街頭觀賞!現在就讓小編帶你一起回顧昨晚跨年晚會的精彩亮點吧~下載食尚APP,天天免費抽大獎!

小龍女、怕胖團、TRASH熱力開場

「2025年臺北最High新年城」跨年晚會以「動」為主題概念,規劃4大多元舞台帶來精彩表演,主舞台更有超過15組超強卡司接力演出!晚會開場由中華職棒味全龍啦啦隊Dragon Beauties小龍女與DJ RayRay聯手獻上熱力十足的表演,14位小龍女以動感舞步點燃全場氣氛;人氣樂團怕胖團帶來〈我只想過著最普通的生活〉〈魚〉等人氣歌曲,並與另一大搖滾樂團TRASH首度合作,演唱〈永遠不回頭〉;TRASH也接著帶來〈重感情的廢物〉〈終究還是因為愛〉等經典曲目,為舞台注入沸騰搖滾能量。

▲今年台北101施放長達6分鐘的煙火大秀,畫面被網友讚為是史上最美的一屆。(圖片提供:臺北觀傳局)

▲跨年晚會開場,由Dragon Beauties小龍女與DJ RayRay帶來熱力四射的演出。(圖片提供:臺北觀傳局)

經典大咖接力、現場秒變萬人KTV

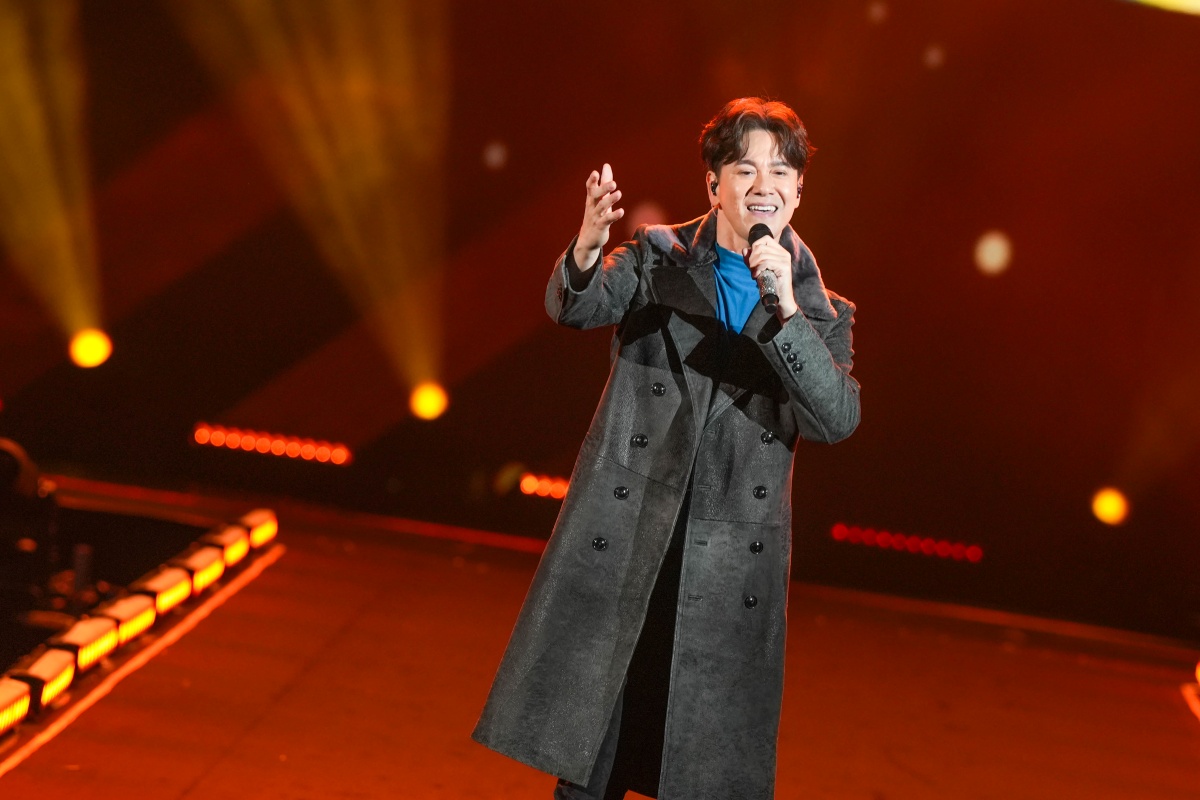

接著一連串人氣歌手上陣,帶來多首膾炙人口的經典歌曲,讓現場變身萬人KTV!金曲歌后戴佩妮以〈怎樣〉〈你要的愛〉等深情歌聲觸動觀眾內心;人氣新生代Karencici與J.Sheon輪番登台,2人聯手獻上〈愛你但說不出口〉;搖滾女王楊乃文睽違18年重登台北跨年晚會,帶來經典曲目〈星星堆滿天〉、新曲〈Flow〉等;情歌王子李聖傑演唱招牌情歌〈手放開〉〈痴心絕對〉,與全場觀眾一同嗨唱。金曲樂團宇宙人帶來〈藍色的你〉〈一起去跑步〉等輕快歌曲,台下觀眾也跟隨節奏搖擺、一起哼唱。

▲楊乃文、李聖傑等經典大咖接力登台,帶來多首觀眾熟悉的經典歌曲,讓現場身萬人KTV。(圖片提供:臺北觀傳局)

加拿大最紅聲樂老師驚喜現身飆歌

晚會中段更有令人意外的彩蛋!YELLOW黃宣先是在舞台上視訊連線加拿大人氣聲樂老師Rozette,隨後Rozette本人竟驚喜現身舞台,2人共同演唱經典名曲〈Shallow〉,技巧高超的完美歌聲,讓台下觀眾驚嘆連連。獨家卡司還有韓國女團Apink,帶來〈Mr. Chu〉〈LUV〉等熱門曲目魅力登場,全場尖叫聲不斷;今年重磅回歸的ENERGY除了演唱〈放手〉等嗨歌,尤其唱到〈星期五晚上〉時,現場無論大人、小孩都忍不住高聲同唱,大跳爆紅舞步「16蹲」,將氣氛炒到最高點!

▲2024年爆紅的加拿大聲樂老師「Rozette」驚喜現身與YELLOW黃宣合唱,讓台下觀眾驚呼連連。(圖片提供:臺北觀傳局)

▲韓國人氣女團Apink首度來台陪伴粉絲跨年,並帶來多首人氣歌曲串燒。(圖片提供:臺北觀傳局)

▲ENERGY演唱熱門嗨歌「星期五晚上」,帶領全場大大小小一同齊唱跳舞。(圖片提供:臺北觀傳局)

市長攜手奧運、世棒金牌喜迎2025

接近倒數時刻,則由2024捷運盃街舞大賽冠軍舞團HRC BEAST CREW SHADOW、霹靂舞奧運國手孫振與City4舞團登場,以精彩舞蹈表演,贏得觀眾掌聲。接著再由臺北市長蔣萬安攜手2024巴黎奧運羽球金牌王齊麟、拳擊金牌林郁婷,世棒12強金牌選手味全龍李凱威和陳冠偉4位傑出運動選手,與現場民眾熱情互動,吉祥物熊讚與壯寶也共同登台,蔣萬安致詞祝福大家新年快樂、2025「蛇馬龍鶴」,與所有線上、線下觀眾共同倒數,迎接2025年到來。

▲臺北市長蔣萬安邀請4位2024奧運、世棒金牌選手至現場,陪伴民眾一同倒數。(圖片提供:臺北觀傳局)

梁詠琪、八三夭壓軸再掀高潮

緊接著2組壓軸大咖接連登場,讓晚會氣氛再掀一波高潮!梁詠琪重現去年臺北小巨蛋演唱會的開場曲〈Spaghetti〉,帶來無限幻想與新年的希望,隨後以〈膽小鬼〉等經典曲目,喚起觀眾滿滿的回憶;搖滾天團八三夭接著登場,帶來〈東區東區〉〈乾啦乾啦〉等熱血沸騰的歌曲,為「2025臺北最High新年城」跨年晚會畫下圓滿句點。

▲最後壓軸由搖滾天團八三夭登場,以一連串嗨歌串燒,為精彩晚會畫下句點。(圖片提供:臺北觀傳局)

臺北最High新年城-2025跨年晚會

原文轉載來自:來源連結