中華職棒味全龍隊為網羅朱育賢,讓樂天桃猿選擇補償辦法,最終以「錢+人」方式定案,除了指名25人保護名單外的呂詠臻,還可獲得朱育賢年薪的75%,即675萬元;味全隊於今天在臉書發文,「感謝詠臻這些日子對味全龍的努力與付出!」並祝福他,「未來繼續在球場上閃耀!」。

味全龍在臉書上貼文:

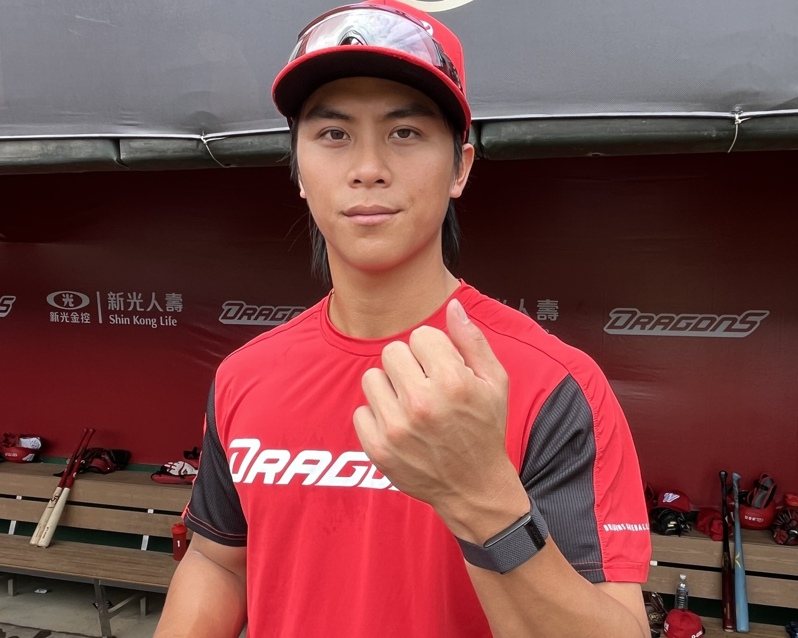

Thank You!呂詠臻

2020年選秀會上,呂詠臻在第6輪被味全龍選中披上龍袍。在味全龍效力的四個球季中,於2022年迎來一軍初登場,累積出賽80場,貢獻5勝3敗、12次中繼成功及1次救援成功的成績。

謙虛有禮的呂詠臻不僅在投手丘上全力以赴,更以帥氣的外型與出眾的歌喉徵服許多球迷,曾兩度榮獲味全龍「龍星大樂」冠軍。無論在場上還是場下,面對各種挑戰總是全力以赴,感謝詠臻這些日子對味全龍的努力與付出!即將開啟職棒生涯的新篇章,衷心祝福詠臻能一切順利,未來繼續在球場上閃耀!

味全龍迷也紛紛表示不捨,「詠臻加油,祝福你到新的舞台繼續發光發熱!」、「呂帥加油!到樂天拿個救援王吧!」、「詠臻以後就是可敬的對手了,期待未來的每一場對決。」

標題:中職/呂詠臻改披桃猿戰袍 味全發文「Thank You」龍迷不捨

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。