致力於實踐 2040 年達成碳中和的知名豪華汽車品牌VOLVO,今年8月正式加入臺北市立動物園認養計畫,認養園內動物明星-國王企鵝,與臺北市立動物園攜手推廣極圈動物保育,引發各界熱烈迴響,呼籲日常減碳行動、守護國王企鵝棲地。

年末將至,VOLVO與臺北市立動物園將合作計畫進一步擴大,打造企鵝館內及館外周邊成為永續互動展場,即日起至2025年2月21日限時展出,邀請大小朋友利用元旦周末和即將到來的新年假期,造訪臺北市立動物園,和 跟隨一起學習日常永續知識,共同守護國王企鵝家園。

隨著全球暖化加劇導致海水溫度上升,1986 年至 2023 年南極海冰面積已消融減少超過 100 萬平方公里,全球超過 50% 企鵝也正面臨家園不斷縮小,食物逐漸稀少等生存難題。其中,全球企鵝種類中體型第二大的國王企鵝,也因棲地逐漸消失,導致覓食地與繁殖地距離不斷拉大,面臨捕食困難、企鵝幼崽不易存活等重大威脅。至 2100 年,可能有 70% 的國王企鵝將面臨失去棲息地,甚至滅絕的危機。因此,當守護極圈動物棲地已成為環境保育的迫切課題,VOLVO 透過加入臺北市立動物園的認養計畫,邀請大眾一同於日常生活中實踐減碳行動。

VOLVO作為全球首家宣布電氣化策略的國際豪華汽車品牌,秉持對永續發展的承諾,不斷朝 2040 年達成碳中和目標邁進。不僅於所有歐洲工廠開始使用水力發電減碳,更將品牌永續方針落實在地市場,攜手全台經銷體系汰換老舊高耗能設備,推動綠能基礎設施,並透過日常監控管理及再生能源系統的導入,力求 2025 年於零售體系達成碳排放減少 50% 的目標。

除此之外,VOLVO 延續品牌在地永續能量,投入臺北市立動物園動物認養計畫並展開系列活動,將環境氣候議題、極圈動物保育觀念植入親子出遊場域,運用寓教於樂參觀體驗,讓親子們將永續理念融入日常生活,為守護極圈動物貢獻一份力量。

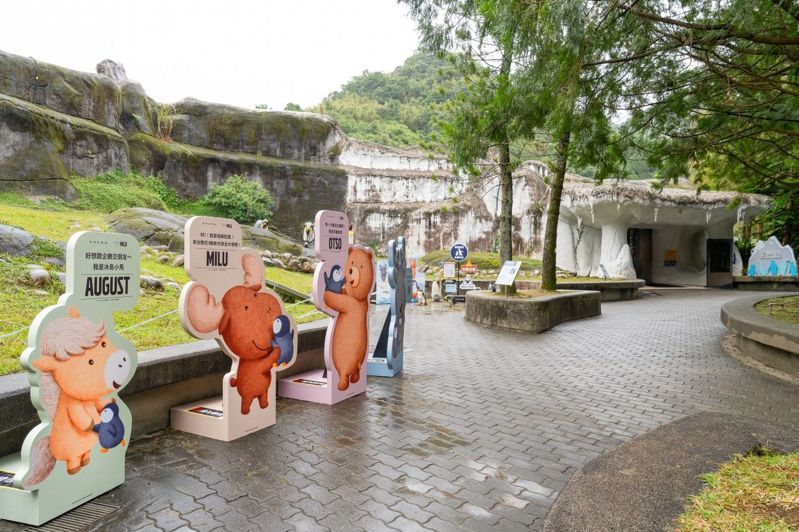

趁著年末佳節前夕,VOLVO 於臺北市立動物園企鵝館內及周邊,以品牌安全大使 MILU 與他的好友們為主題,精心打造可愛童趣的永續互動展覽空間,館外可以看見 MILU 與好友們的可愛造型立牌,館內設置萌度滿點永續主題壁貼與掛旗,邀請大朋友小朋友一窺與國王企鵝有關的趣味永續知識。

館內展區更結合「MILU 永續萌友 + 1」數位快問快答遊戲,民眾掃描展牆 QR Code 後,從館內的海報中,吸收豐富的減碳生活概念及極圈動物保育知識後,完成答題並留下基本抽獎資料,有機會抽中 MILU 大型玩偶。

此外,凡於企鵝館活動展區拍照打卡上傳並標註 MILU 官方帳號,還有機會抽中限量 MILU 百變表情吊飾,喜歡 MILU 的民眾千萬別錯過!企鵝館出口的企鵝小舖中,也將同步販賣深受大小朋友喜愛的MILU 精品,歡迎正在規劃假期親子出遊民眾,一起到臺北市立動物園尋找 MILU 與動物好友們的身影,在有趣的動物永續知識當中盡情探索,共同落實減碳,保護極圈動物的家。

原文轉載來自:來源連結