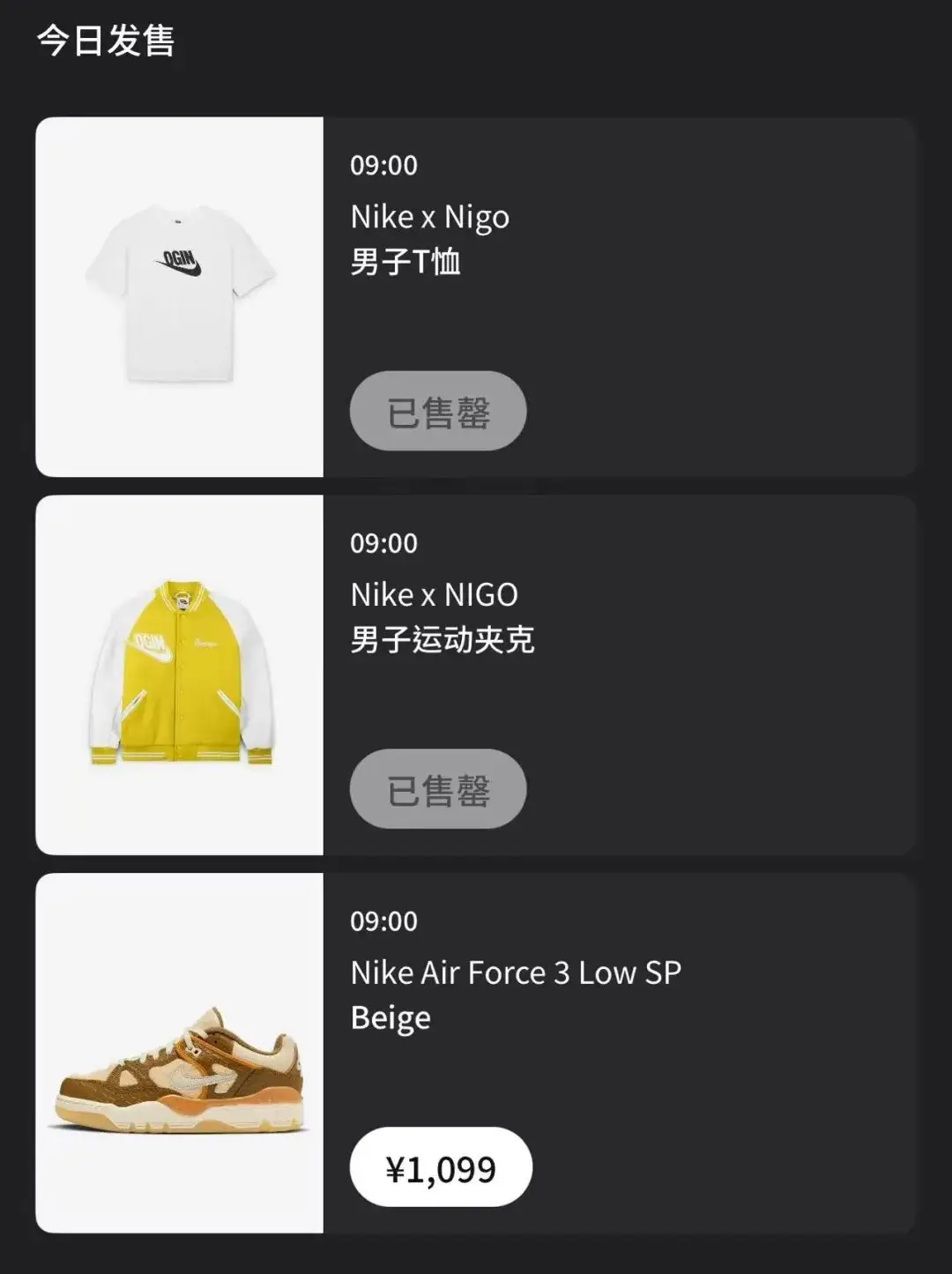

今早登場的 尼戈x 耐吉聯名新品大家都搶了嗎?

除了國區已經上架的這款棒球夾克,幾天前 Nigo 在 Ins 曬出與 j-hope 合照的時候,還穿了件從沒見過的 Nike 聯名新品。

尚未市售的這款棒球夾克,將 Nike 經典標語「Just Do It」饒有趣味地更改爲「Just Did It」。

之前的聯名款把 Nike 改成 Nigo 替換了兩個字母,這次只改一個,Nigo 真有你的啊!

展開全文

左右口袋的位置分別裝飾 Nigo 籤名刺繡以及賽車風格圖案,而右臂顯眼的綠色貼布則印有 Nike Swoosh Logo。

這樣一款充滿玩味的外套,你覺得怎么樣呢?

目前,該款棒球夾克暫未有發售信息曝光,預計很快就會正式登場,感興趣的朋友不妨留意。

圖片來自:uarmyhope

「部分圖片來源於網絡,如牽涉版權

請聯系 [email protected] 更正」

標題:Nigo 又跟 Nike 整新活兒!網友:真會玩!

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。