日前,以“From Geometry to Artistry®匠藝幾何”年度主題爲創意靈感,江詩丹頓“匠藝幾何”全國巡展登陸重慶。江詩丹頓於“鐘表與奇跡”日內瓦高級鐘表展中發布的臻品傑作與於今年發布的Métiers d‘Art藝術大師系列腕表都悉數亮相。

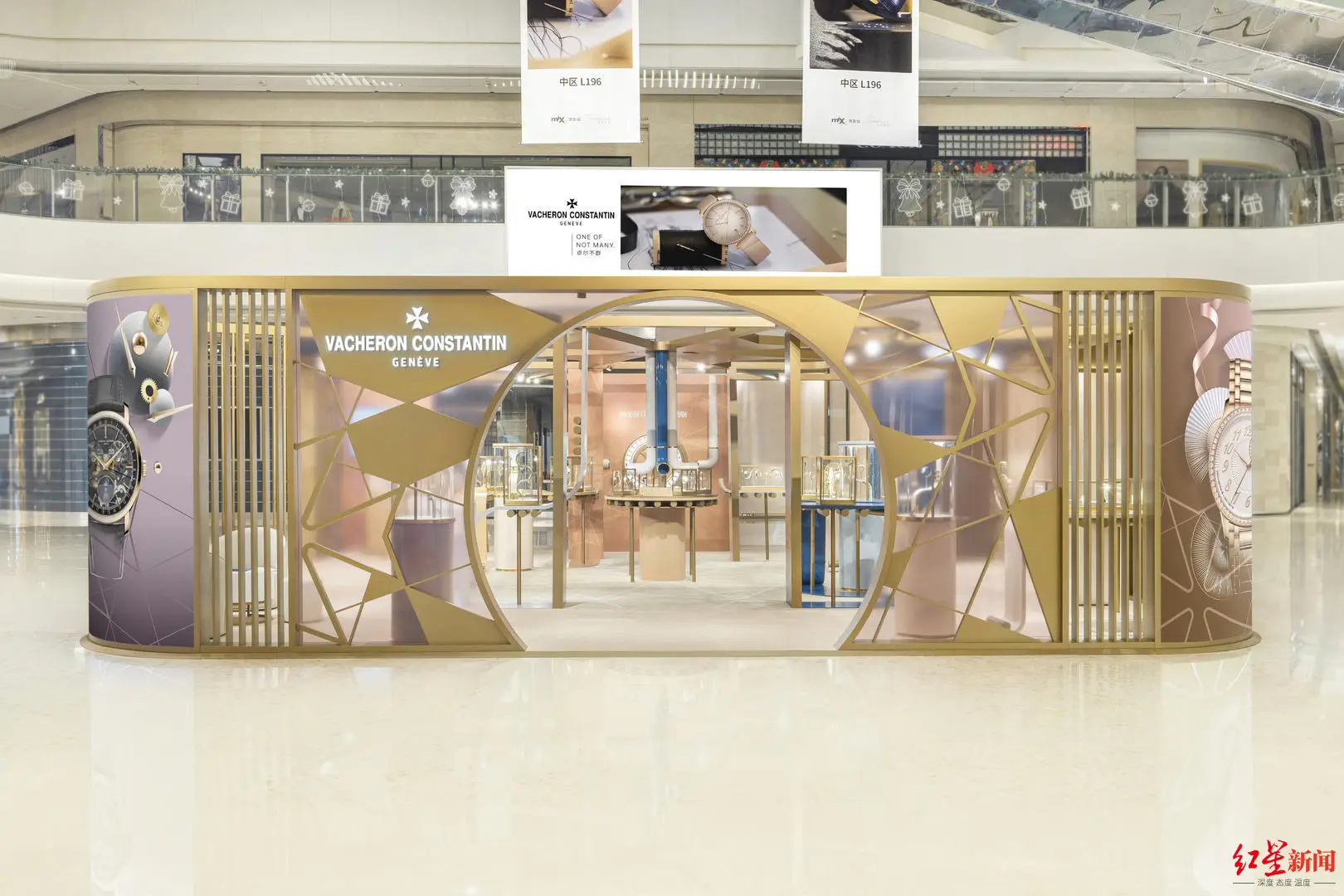

本次巡展,江詩丹頓別具心裁地將展廳打造成一座創意制表工坊,將“From Geometry to Artistry®匠藝幾何”年度主題的精髓得以淋漓呈現。據介紹,江詩丹頓的時計作品並非只是各種機械部件的排列組合,而是基於對精妙數字的縝密思考,以及對幾何美學的不懈探索,隨着腕表的幾何輪廓被逐漸勾勒成形,並融入卓越的制表技藝,一個由造型、色彩與紋理交匯而成的藝術之境便由此誕生。

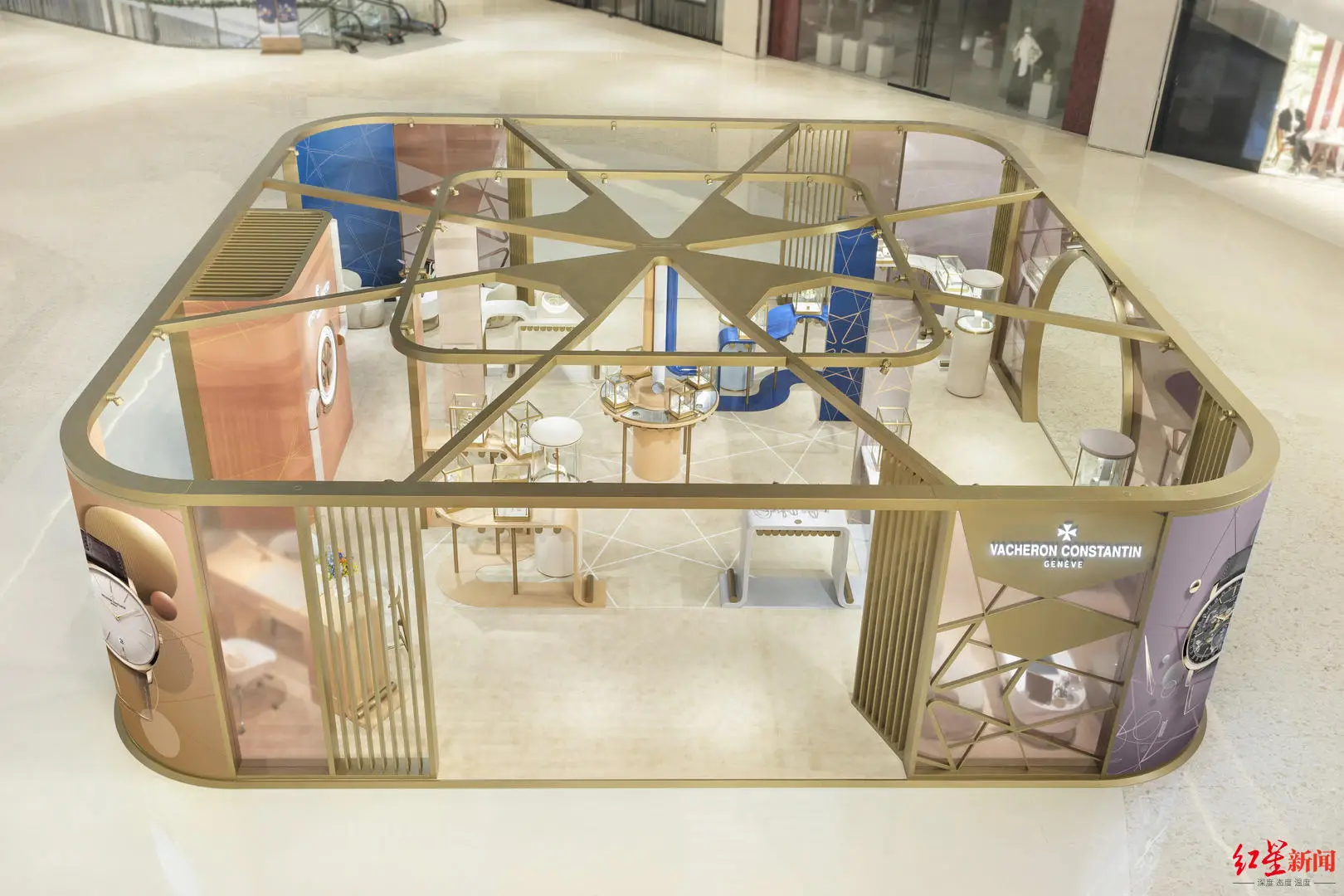

置身於這一全新展廳,其充滿逸趣的藝術裝置與多元交互體驗將帶來引人入勝的探展之旅,引領品味鑑賞家們步入江詩丹頓“卓爾不群”的高級制表世界。首先映入眼簾的便是展廳的核心區域——品牌爲本次巡展特別打造的中央裝置,該裝置以藝術化視角模擬了江詩丹頓制表工坊的工作流程:從採擷靈感、匯聚創意,再到組裝成體,最終精妙呈現。品牌標識性的馬耳他十字設於展廳頂部中央,邊緣线條向四周無限延展,將整個體驗空間融爲一體。

展陳空間中,江詩丹頓帶來了於2024年“鐘表與奇跡”日內瓦和上海高級鐘表展中發布的臻品傑作。其中,Métiers d‘Art藝術大師系列中國十二生肖傳奇之蛇年腕表尤爲矚目,該款腕表致敬了品牌與中國的深厚情緣以及爲生肖主題作品开啓新一輪循環。同時,Métiers d‘Art藝術大師系列“致敬中國文化標志”月耀河山腕表,從“海水江崖紋”擷取設計靈感,以極具衝擊力的設計語言和工藝表達,傳遞中華傳統文化豐富悠久的意涵。

展開全文

江詩丹頓藝術大師系列“致敬中國文化標志”腕表“月耀河山”粉紅金款

江詩丹頓藝術大師系列中國十二生肖傳奇之蛇年腕表 粉紅金款

此外,以古銀色表盤搭配全新橄欖綠色表帶的Patrimony傳承系列月相逆跳日歷腕表、以全鈦金屬材質亮相、演繹運動精神與時尚美感的Overseas縱橫四海系列陀飛輪腕表、以鎏金格調優雅呈現的Historiques歷史名作系列222腕表等都在本次展覽中亮相。

值得一提的是,江詩丹頓還一一拆解各系列的標識美學元素,將它們的專屬故事娓娓道來:Égérie伊靈女神系列展區以藝術裝置呈現系列特色,指針、時標、小表盤等表盤設計元素,呈現該系列經典的偏心表盤美學設計;Traditionnelle傳襲系列展區的靈感汲取自陀飛輪的設計構造,通過陀飛輪各部件的拆解與合並,可感受品牌陀飛輪的機械構造美感及其中蕴含的精湛工藝。

作爲本次巡展的點睛之筆,品牌在“大師工坊”區域特別設置了“時間魔法書”互動裝置,來賓們不僅有機會與制表大師近距離溝通,感受高級制表的非凡魅力,更可通過與“時間魔法書”的趣味互動,沉浸式了解品牌綿延近270年的豐富歷史與期間的腕表傑作。觀衆還可通過微信小程序掃描其幾何形狀以解鎖AR互動體驗,或线上參與展覽,體驗“匠藝幾何”的創意巧思。

(羅文藝)

標題:江詩丹頓“From Geometry to Artistry匠藝幾何”全國巡展登陸重慶

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。