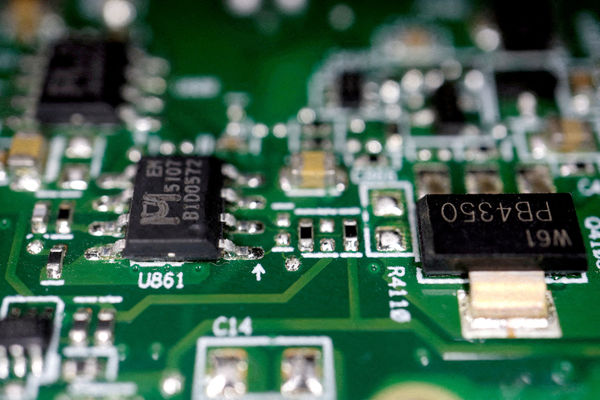

▲台灣半導體產業協會執行長吳志毅說,台灣應透過伺服器及晶片設計等優勢,降低AI應用進入門檻,讓百工百業AI化。(示意圖/路透)

文/中央社

台灣半導體產業協會(TSIA)執行長吳志毅18日表示,伺服器和晶片設計等是台灣的主場優勢,台灣應藉由這些優勢降低AI應用進入門檻,讓百工百業AI化。

吳志毅18日出席行政院全國科學技術會議演講「創新與永續:智慧科技賦能未來經濟」。他說,這次全國科學技術會議圍繞在人工智慧(AI)和半導體,其中,AI並不是新學問,在1950年時期進展不大,主要是讓電腦具有邏輯推論能力。

吳志毅表示,1980年時期,AI有非常顯著的進展,讓電腦有人的學習能力,IBM的深藍打敗西洋棋王;2010年時期,在演算法進步下,AlphaGo戰勝圍棋棋王。最近10年更快速進展,使得AI自傳統的鑑別式AI變成生成式AI。

吳志毅說,硬體進步是生成式AI蓬勃發展的主要助力,半導體製程技術從2010年的10幾奈米,至今即將推進2奈米,此外,透過3D堆疊可以加大記憶體頻寬。

據觀察,全世界市值前10大企業中有8、9家與AI有關。吳志毅表示,AI是發展重要趨勢,預期2030年AI對世界經濟貢獻可望超過15兆美元。

吳志毅指出,隨著創投資金投入AI發展,AI生成式AI獨角獸達到10億美元估值的平均時間僅約3.4年,較其他獨角獸的時間短50%。

吳志毅說,視覺瑕疵檢測是半導體製程、印刷電路板和封測最常使用的AI應用,AI還可用於流程最佳化,以及智慧醫療、零售庫存規劃和生成廣告影片等。

至於AI發展的隱憂,吳志毅表示,高耗電是其中一點,估計2030年AI資料中心將消耗全美國10%的電力,因此發展資料中心冷卻及節能技術是重要課題。

此外,吳志毅說,高品質資料會越來越少,未來需要合成資料,資安發展以及商業模式改變等,也都是AI發展需要注意的問題。

吳志毅表示,台灣的資料量、算力及軟體人才不足,不適合發展通才型AI,不應投入大型語言模型發展,應該發展專才型AI,做好模型加值應用,使用自己的特定資料訓練,發展小型語言模型。

吳志毅說,全球90%伺服器自台灣出口,是台灣的主場優勢。輝達(NVIDIA)與超微(AMD)大型繪圖處理器(GPU)主要用於AI訓練,不是台灣發展的方向,台灣應發展推論晶片。

半導體製程即將推進至2奈米,吳志毅表示,半導體技術距離物理極限還有很遠距離,可以透過材料與元件結構改變繼續發展,估計至少還可以發展20年。

吳志毅說,能源、減碳是可能減緩半導體進展的因素,半導體產業致力達到產業繼續成長、碳排降低的目標,台灣半導體產業協會制定淨零排放路徑圖,計劃碳排於2025年達到高峰,透過自主減碳及使用再生能源,2030年碳排較2020年減少10%。

吳志毅表示,2050年半導體產值倍增,透過製程最佳化、使用再生能源,加上碳捕捉等負碳技術,力求達到淨零目標。

吳志毅說,台灣應透過伺服器及晶片設計等優勢,降低AI應用進入門檻,讓百工百業AI化。台灣擁有完善的供應鏈及豐富的資通訊人才,應投入小型模型發展,結合在地產業特色,打造技術優勢及競爭力,透過提升用電效率達到永續發展。

標題:台灣半導體產業協會:伺服器和晶片設計是台灣優勢 有助百業AI化

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。