大多數人對於黑色羽絨服的印象並不深刻,甚至感覺黑色羽絨服很單調,但是日常生活之中我們能看到各種各樣的羽絨服,短款的長款的也有不同的顏色,而黑色羽絨服的搭配也是有很多種的,如果你入手了一件黑色的羽絨服但不知道怎么去搭配,可以看看下面這些時尚的搭配方案,或許會給你帶來靈感。

第一章:黑色羽絨服很實用,這些搭配方案建議你來看看

▼黑色羽絨服如何搭配才能突出時尚感?

[1]搭配條紋毛衣,減齡顯潮流

黑色羽絨服雖然看上去比較低調,但是如果想要強調時尚感,我們就不能忽略內搭的挑選。

可以選擇一些個性或者是具有設計感的內搭去改善造型的視覺衝擊力。比如說這件黑色羽絨服搭配上了這種黑白條紋的毛衣,這樣簡約的條紋紋路看上去是很經典的,也能夠和黑色的羽絨服相互交融,避免單調感。

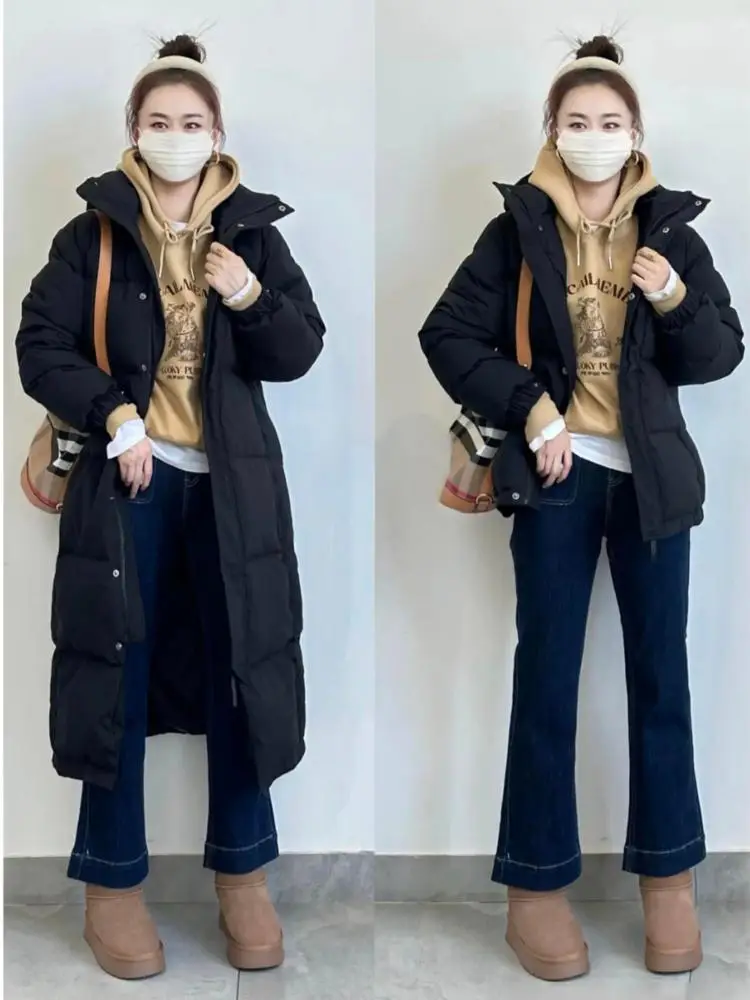

[2]疊穿搭配,層次感十足

展開全文

黑色羽絨服無論是短款還是長款,它的搭配都是非常靈活多樣的,有些女生可能覺得黑色羽絨服比較厚重,平時搭配也不想要選擇太輕薄的搭配,想要加強保暖效果,那這時候可以試試疊穿。

像這種基礎款的白t搭配連帽的衛衣, 就可以直接在裏面疊穿,利用這種寬松的衛衣疊穿在裏面增加造型的層次感,也可以凸顯出更強的時尚性。

第二章:黑色羽絨服的搭配不止一種,這些套路值得一試

[搭配示範①]黑色羽絨服配綠色毛衣,活力十足

秋冬季節羽絨服的搭配雖然看上去沒有太多的亮點,但實際上,在這個季節大家所選擇的大部分服飾都是比較厚重的,所以我們在搭配時也需要在顏色還有款式上去融入一些特色。

剛剛提到的黑色羽絨服搭配上低調不張揚的綠色毛衣,可以起到減齡效果,整體的風格看上去也更加青春活潑。

[搭配示範②]直接配棕色闊腿褲,展現貴氣感

配色方面的搭配技巧很多,但是我們所選擇的顏色不能太復雜,簡單的雙色搭配,或者是三色搭配,這樣看上去才不會顯得很繁瑣。

比如這種經典的黑白配色,它的搭配方案就非常簡單,黑色的羽絨服和棕色的闊腿褲相互襯托,棕色的褲子有一種高級的貴氣感,這種搭配的色彩也非常的簡單,沒有太多復雜的設計,既實用又不失潮流。

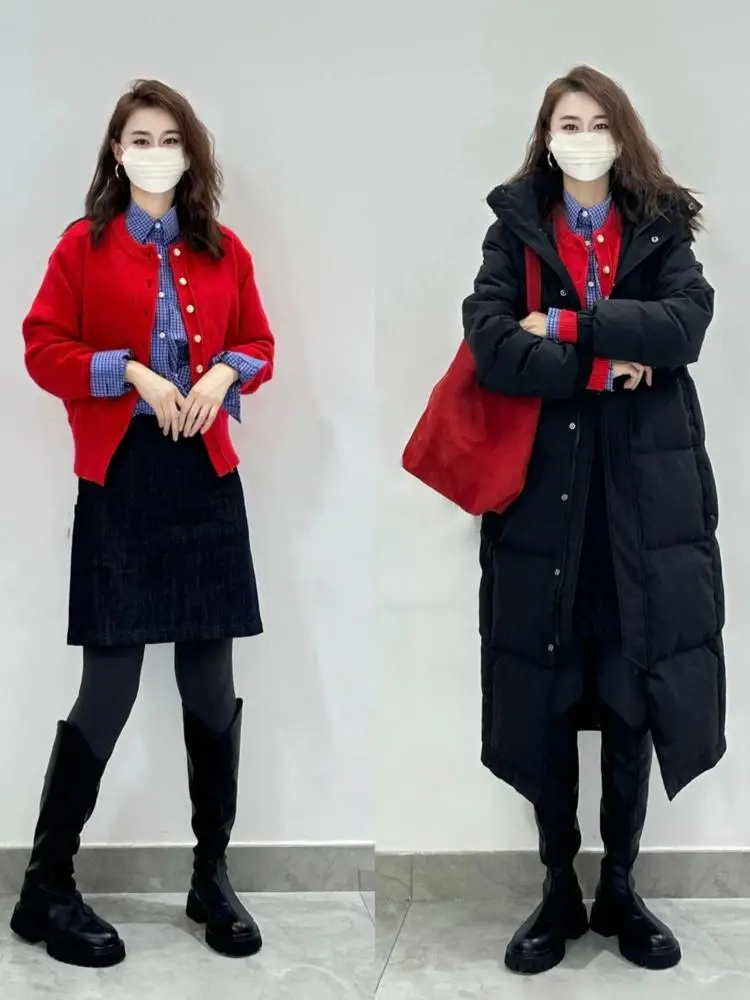

[搭配示範③]格子衫疊穿,提升層次感

黑色羽絨服的搭配方案有很多,除了可以直接疊加同色系的內搭之外,我們也可以考慮一下不同風格的單品疊穿。

比如說一般情況下,覺得黑色羽絨服的搭配只會導致造型單調和無趣,但是我們可以用這種時尚的格子衫疊穿,格子衫的穿搭是永恆不過時的,用這種簡約的格子元素去修飾,能夠讓我們的造型看上去更加時尚。

[搭配示範④]紅色毛衣开衫,提亮效果極好

格子衫疊穿羽絨服的搭配方案非常適合這些想要減齡的女生,而疊穿這種格子衫時也可以考慮在裏面搭配一件有設計感的开衫,這樣的話就能夠讓我們的造型看上去更有層次感。

簡單的黑色羽絨服配上這樣一件紅色开衫,紅色是具有膨脹感的顏色,能夠讓我們的造型看上去更爲飽滿,也有更強的潮流感。

第三章:黑色羽絨服的搭配套路總結,這些技巧你掌握了嗎?

領口選擇V領款,遮肉效果更強

想要身材看上去瘦一些,內搭的選擇是非常重要的,作爲大衆最爲常選擇的基礎款黑色羽絨服,雖然簡單,但是內搭的挑選卻可以影響到你的搭配效果。

身材偏胖的女生不適合直接搭配高領款的服飾,選擇這種V領的款式更好,V領的領口可以露出我們的脖子,避免壓低我們的個子。

長款短款都適用,搭配靈活多樣

無論是短款的黑色羽絨服還是這種長款的黑色羽絨服,在具體搭配時都可以參考上面這些疊穿的方式,能夠讓我們的造型看上去更時尚,也可以讓我們的穿搭變得多樣化。

短款羽絨服可以疊穿一些有設計感的衛衣,用長款的衛衣搭配短款的羽絨服,拉長我們的比例。

而長款的羽絨服則可以搭配這種長褲,通過上短下長的搭配,可以讓我們的身材比例看上去更好。

黑色羽絨服的搭配套路很多,這些時尚的搭配方案不僅能夠讓我們學會黑色羽絨服的不同搭配方式,同時也可以讓我們學會黑色單品的搭配技巧,掌握這些技巧後,你的穿搭將會更加多樣。

標題:當你有件黑色羽絨服卻不知道怎么搭配時,這幾組搭配公式,快收藏

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。