自創立以來,Van Cleef & Arpels梵克雅寶忠於對生命的詩意聯想,將獨特的夢想與情感帶入鐘表世界,以精湛的制表工藝與精彩紛呈的巧思創想灌注款款時計臻品,銘刻分秒時光的優美律動。世家從跨越百年的歷史和多種經典靈感源泉中捕捉每一個動人的詩意瞬間,譜寫出一闋闋美好戀曲和幸運傳奇。愛情、仙子、芭蕾、大自然以及寰宇星空等世家珍愛的靈感源泉和諧節奏,於不同腕表系列中共譜Poetry of Time時間的詩篇,每分每秒皆演繹着優雅迷人的風範。

Van Cleef & Arpels梵克雅寶仰承其歷史底蕴的滋養,以métiers d’art大師工藝升華韶光的流逝,淬煉出奧妙無窮的玲瓏天地,鑄就醉人的腕上奇珍。一個多世紀以來,工藝始終是Van Cleef & Arpels梵克雅寶發展的重心,彰顯世家完善傳統技術、同時引入嶄新創意的初心。世家位於日內瓦的工坊匯聚一群技藝超群的工匠,從他們雙手中誕生的每一件作品,均將琺琅、微型彩繪、珍貴和裝飾寶石鑲嵌、雕刻與鐫刻藝術等卓越工藝傳承並升華。

琺琅工藝:融會傳統與創新

在métiers d’art大師工藝範疇上,世家堅信其獨一無二的專業造詣,並於日內瓦建立自有的琺琅工坊,它無疑是享譽全球的頂級工藝殿堂之一。世家亦通過其腕表系列向歷史悠久的琺琅工藝致敬,多年來,以墨彩琺琅、plique-à-jour彩色玻璃琺琅、丘陵狀琺琅、琺琅鑲嵌、façonné立體琺琅以及藍寶石玻璃琺琅貼花等琺琅藝術,打造立體生動的裝飾細節,將迷人景致與詩意故事凝於方寸之間。世家不僅將古老技法薪火相傳,更在革新琺琅技術方面成就斐然,創造出立體生動的裝飾細節。面對每一項新挑战,世家工匠潛心研發數年,以實現Van Cleef & Arpels梵克雅寶Creative Studio創意工作室的設計概念。過程中,科學與藝術對話不斷,只爲在精湛技術和美學風格之間取得平衡,將方寸腕表盛載的詩意故事娓娓道來。

展開全文

墨彩琺琅

墨彩琺琅於16世紀在法國利摩日興起,通過兩種顏色琺琅的相互作用產生明暗對比效果,別具特色。金屬底座先塗覆一層黑色或藍色琺琅,之後塗覆名爲“利摩日白釉”(Blanc de Limoges)的白漆,厚薄程度視所需效果而定。由此產生的雙色效果賦予表盤深度和神祕感。

爲表盤塗上第一層琺琅

爲表盤塗上第一層琺琅

Lady Arpels Pont des Amoureux腕表傳承這一精湛工藝,以“利摩日白釉”的皓白之色,微繪於方寸深邃表盤,以對比之美,再現巴黎的浪漫夜晚。

Lady Arpels Pont des Amoureux 腕錶

38毫米白K金鑲鑽表殼

白K金表盤,飾以墨彩琺琅

自動上鏈機械機芯,搭載雙逆跳模塊及按需動畫模塊

時光更迭,世家秉持對於工藝的不斷探索,以彩色墨彩琺琅技術爲四枚高級珠寶腕表表盤鍍上繽紛的色彩,演繹跨越四季的巴黎的愛戀:春天,繁花錦繡,巴黎布滿浪漫的粉紅色;盛夏時節,蝴蝶宛如新生,翩翩飛舞於藍天;時光流轉,秋日沓來,落葉輕舞,仿佛爲愛侶舞一曲愛的頌歌;冬日,晶瑩的雪花飄落,爲屋頂點綴雪白的華服。

Lady Arpels 情人橋春季腕錶

38毫米玫瑰金表殼,雪花鑲嵌鑽石、鑽石、

彩色墨彩琺琅,微型彩繪、

粉紅色、淡紫色和紫色藍寶石

自動上鏈機械機芯,搭載按掣動畫逆跳模塊,

配備36小時動力儲存

獨立編號版本

Lady Arpels 情人橋夏季腕錶

38毫米白K金表殼,雪花鑲嵌鑽石、鑽石、

彩色墨彩琺琅、微型彩繪

黃色藍寶石及錳鋁石榴石

自動上鏈機械機芯,搭載獨家研發按掣動畫逆跳模塊,配備36小時動力儲存

獨立編號版本

Lady Arpels Pont des Amoureux Printemps 腕表,38毫米玫瑰金表殼,雪花鑲嵌鑽石、鑽石、彩色墨彩琺琅,微型彩繪、自動上鏈機械機芯,搭載按掣動畫逆跳模塊,配備36小時動力儲存,獨立編號版本

Lady Arpels 情人橋秋季腕錶

38毫米黃K金表殼,雪花鑲嵌鑽石、鑽石、

彩色墨彩琺琅、微型彩繪

黃色藍寶石及錳鋁石榴石

自動上鏈機械機芯,搭載

按掣動畫逆跳模塊,配備36小時動力儲存

獨立編號版本

彩色墨彩琺琅技術需要30至40小時才可完成,每枚表盤均經十余次反復窯燒,最終可達至美之境。世家運用獨到的光影與色彩描繪不同季節的天空,令代表每一個季節的時計作品彰顯與衆不同的氛圍。表盤上的細致場景則通過琺琅微型彩繪工藝,描摹拱橋下的春日繁花、夏之蝶舞、秋之落葉和冬日白雪。

Plique-à-jour彩色玻璃琺琅

爲蝴蝶翅膀裝嵌彩色玻璃琺琅飾片

爲蝴蝶翅膀裝嵌彩色玻璃琺琅飾片

Plique-à-jour彩色玻璃琺琅在光线和透明度上呈現出水晶般的清澈,讓人聯想起彩色玻璃。圖案被設計成鏤空結構,然後填充薄層半透明琺琅,在每層之後燒制,以呈現飽滿濃鬱的色彩。

Lady Arpels Papillon Automate腕表以層次豐富的浮雕爲背景,重塑出錯落有致的花園景致,映襯翩翩蝶舞。藍紫色蝴蝶停佇於珍珠母貝雕刻而成的花卉上,雙翼以雙色plique-à-jour彩色玻璃琺琅細工裝飾。內填琺琅點綴着綠草如茵的田園景色,數塊弧型葉片以弧面彩色玻璃琺琅帶出層次豐富的藍綠漸變色彩。琺琅釉彩晶瑩剔透,巧妙糅合三維效果,很好地凸顯出表盤的縱深。金屬薄片嵌飾琺琅化作一輪明月,映照在由藍色、粉紫及紫色藍寶石鑲嵌而成的湖水中。閃爍的花冠以圓型和梨型鑽石點綴,璀璨迷人。

Lady Arpels Papillon Automate腕錶

40毫米白K金表殼、鑽石、彩色藍寶石、珍珠母貝、內填琺琅、金屬薄片嵌飾琺琅、

plique-à-jour彩色玻璃琺琅及弧面彩色玻璃琺琅工藝、微型彩繪、藍寶石水晶

自動上鏈機械機芯,配備按掣顯時裝置

藍色短吻鱷魚皮表帶

限量編號版

仙子在幻境之中輕揮魔杖,伴隨着柔和的晚霞,於Lady Féerie Or Rose腕表表盤上演繹點滴流轉的時光。剔透的半透明粉紅色plique-à-jour彩色玻璃琺琅與不透明粉紅色琺琅釉彩交織,爲仙子的翅膀鍍上朦朧漸變的色彩。在雕刻的珍珠母貝背景上,天邊呈現不少於四種微妙色彩,從珍珠白到深紫色,從精致的香檳色到濃鬱的紫紅色,與夕陽余暉交織出絢爛華彩,照亮迷人深邃的浩瀚夜空。世家的能工巧匠經過不少於十次嘗試才能完成這項挑战,實現柔和圓融的漸變效果。

Lady Féerie Or Rose腕錶

33毫米玫瑰金表殼、鑽石

玫瑰金及白K金表盤、粉色藍寶石、鑽石、白色珍珠母貝、plique-à-jour彩色玻璃琺琅

自動上鏈機械機芯搭載逆跳及跳時分針

丘陵狀琺琅與微型琺琅彩繪

丘陵狀琺琅

丘陵狀琺琅作爲傳統工藝的精妙演進,通過在基座的凹痕中精心構築起類似丘陵的浮雕,巧妙地增強了表盤的層次感與色彩的細膩變化,賦予其一種靈動而充滿活力的獨特美感。

微型琺琅彩繪

琺琅藝術家採用微型琺琅彩繪,以媲美調色盤的彩色琺琅釉作畫;琺琅釉以研磨成粉末的硅晶顏料混合油劑調和而成;微型琺琅彩繪是一門古老工藝,可追溯至古希臘和古羅馬時代,至中世紀時期,當時擅用微型彩繪的藝術家們享譽頗豐。徒手繪制需要極高的精確度、靈巧性,以及真正的藝術天賦,同時,每個窯燒工序皆需對精准度一絲不苟地追求。

在丘陵狀琺琅花朵上進行微型彩繪

在丘陵狀琺琅花朵上進行微型彩繪

Lady Arpels Brise d’Été腕表以天藍色丘陵狀琺琅渲染花朵的漸變色彩,層次豐富的微型彩繪嫩枝令構圖錯落有致,演繹仲夏花園的迷人景致。世家工匠戴上放大鏡,爲丘陵狀琺琅花瓣或彩色玻璃琺琅蝴蝶着色,利用細長的貂毛筆描繪出漸變的色調。色彩按照嚴謹的次序層層遞進,展現由淺至深的層次。兩片plique-à-jour彩色玻璃琺琅草葉優雅交織,點綴於背景之中,巧妙勾勒出一幅匠心獨具的微縮畫卷,向大自然的綺麗風光致敬。

Lady Arpels Brise d’Été腕錶

38毫米白K金鑲鑽表殼

珍珠母貝表盤,沙弗萊石榴石及錳鋁榴石、珍珠母貝、微型彩繪、

彩色玻璃琺琅、內填琺琅及丘陵狀琺琅

自動上鏈機械機芯,搭載按掣啓動仿真動偶模塊

Façonné立體琺琅與琺琅鑲嵌技術

爲彰顯微雕表盤上的細致线條,世家於2023年研發出多項復雜技術,包括耗時16個月得以實現完美效果的façonné立體琺琅,以及耗時24個月方能完成的琺琅鑲嵌技術。

Façonné立體琺琅

工匠以高溫熔化琺琅釉彩,再將之輕輕倒在不鏽鋼托盤上,然後通過逐片修削,塑造三維形態。低溫火焰減弱了材質本身的張力,使琺琅經過500 攝氏度 (華氏 930 度) 的高溫釉燒加工後,表面澄澈光滑如鏡,效果媲美拋光潤飾。Façonnné立體琺琅成品層次豐富,綻放剔透光澤,視覺效果無與倫比。

琺琅鑲嵌技術

這門技術旨在於彩色玻璃琺琅上直接鑲嵌寶石,中間並無其他金屬構件協助加固。爲實現這項美學創舉,工匠需將寶石准確置放於鏤空的琺琅上,再以嚴格掌控的溫度進行釉燒,以固定寶石位置,造就優美的“懸浮”效果,更顯寶石的流光溢彩。

清晨的陽光下,一位優雅的仙子正在採擷鮮花,Van Cleef & Arpels梵克雅寶將這賞心悅目的一幕永鑄於Lady Arpels Jour Enchanté 腕表表盤上。世家以façonné立體琺琅工藝生動捕捉花團錦簇的美景,豐富的層次賦予花海一望無際的視覺效果。世家亦採用別具匠心的琺琅鑲嵌技術,於plique-à-jour彩色玻璃琺琅葉片上直接鑲嵌鑽石,演繹出清晨葉片上的露珠。精雕細琢的白K金仙子展开虹彩繽紛的plique-à-jour彩色玻璃琺琅薄翅,盡顯其明亮剔透的質感。表盤背景設計精致迷人,黃K金和橙色錳鋁榴石、黃色藍寶石及鑽石等珍貴寶石則共譜一闋溫煦明媚的陽光變奏曲,嶄新的懸空鑲嵌工藝使寶石有如懸空一般,呈現出輕靈的動感。

Lady Arpels 雅寶女士魔法日

41毫米白K金鑲鑽表殼

白K金、黃K金、彩色藍寶石、錳鋁榴石、鑽石、綠松石、

plique-à-jour彩色玻璃琺琅、façonné立體琺琅、琺琅鑲嵌、懸空鑲嵌

手動上鏈機械機芯

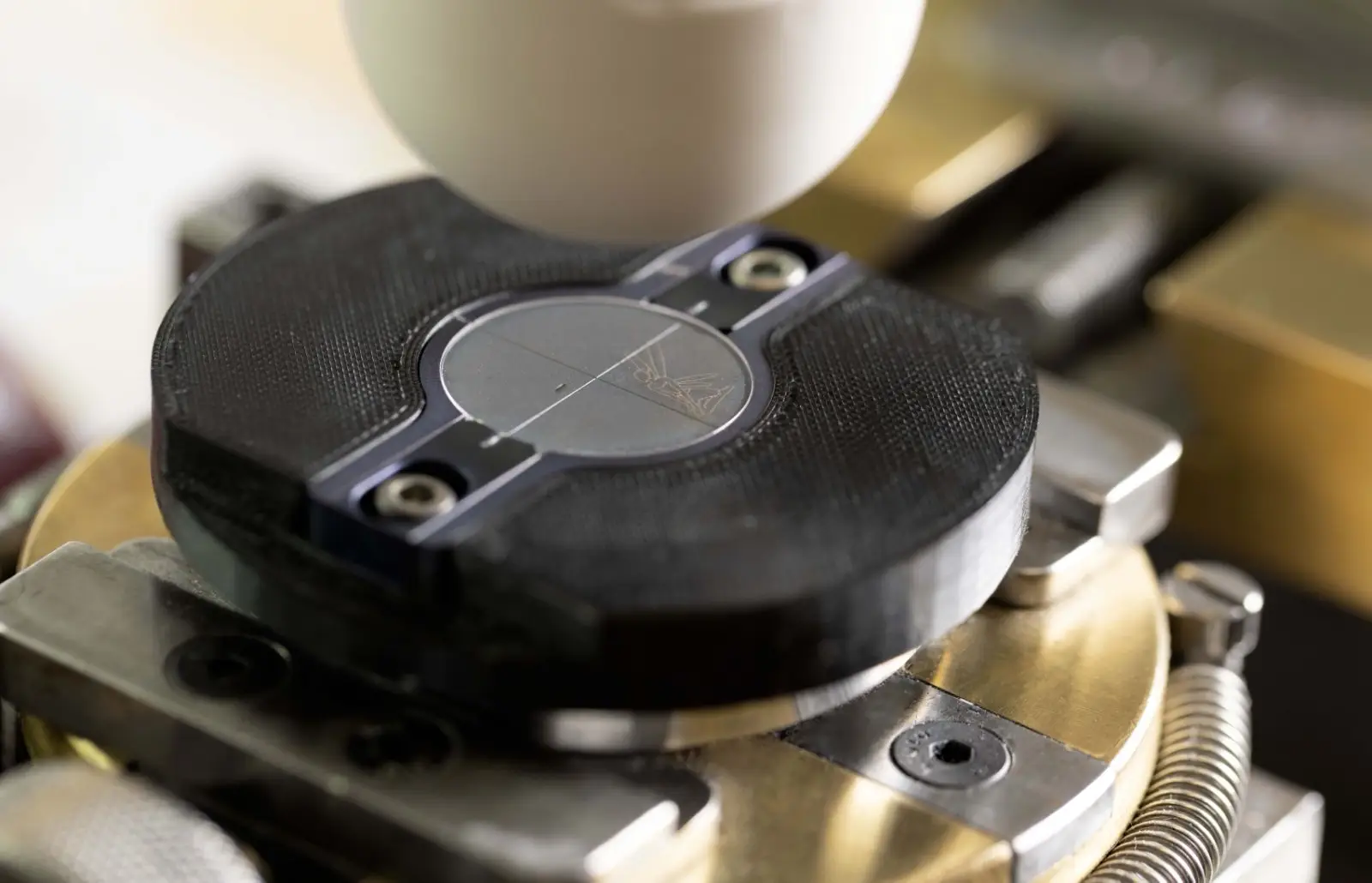

藍寶石玻璃琺琅貼花

藍寶石玻璃上的琺琅貼花,源自歷史悠久的古老工藝,與雕刻工藝相輔相成,達到精妙的潤飾效果。Van Cleef & Arpels梵克雅寶工坊使用傳統的鑄鐵設備以及工坊研發的獨特拓印技術,實現極高的精確度。

藍寶石水晶表盤上的琺琅貼花

藍寶石水晶表盤上的琺琅貼花

組裝表背

組裝表背

Van Cleef & Arpels梵克雅寶仰望夜空,沉醉於浩瀚星河,以無盡遐想凝鑄於制表藝術。2024年,世家將2008年面世的Lady Arpels Jour Nuit腕表重新演繹,以兩枚分別爲33毫米和38毫米的腕表作品,再次定格星月追逐旭日的永恆畫卷。每一塊鑲嵌於Lady Arpels Jour Nuit 腕表和Lady Jour Nuit腕表表底的藍寶石玻璃均塗裝30至36層琺琅釉彩;這項工藝的復雜性在於溫度和釉燒時間之間的完美平衡。風幹每一層釉彩所需的時間,亦需根據所用的琺琅及其整體厚度而有所調整。藍寶石玻璃剔透的表面以琺琅印刻星夜的意象,映照守護仙子的翩翩倩影,將她靜賞這出星際芭蕾的動人情景活現眼前。

Lady Arpels 日夜腕錶

38毫米白K金鑲鑽表殼

砂金石玻璃表盤

珍珠母貝、白K金、

黃K金、鑽石及黃色藍寶石

自動上鏈機械機芯及日與夜模塊

可替換短吻鱷魚皮表帶

Lady Jour Nuit腕錶

33毫米白K金鑲鑽表殼

砂金石玻璃表盤

珍珠母貝、白K金、黃K金、鑽石

自動上鏈機械機芯及日與夜模塊

可替換短吻鱷魚皮表帶

作爲法國“活文化遺產企業(Living Heritage)”,Van Cleef & Arpels梵克雅寶矢志秉持及傳承métiers d’art大師工藝,同時持續精進琺琅等傳統工藝,开拓技術和創作範疇,以融會傳統與創新的精湛工藝垂範業界。世家日內瓦的制表工坊,通過琺琅工坊和培訓學校,精進和傳承這些匠心工藝。描繪風景、雕刻人像、勾勒絢爛金光……世家工匠爲每枚表盤上的故事注入生命,展現登峰造極的精妙技術,爲世家珍視的Poetry of Time時間的詩篇點綴栩栩如生的裝飾,生動演繹世家的幻想世界。

Van Cleef & Arpels梵克雅寶歷史背景

Van Cleef & Arpels梵克雅寶的故事始於1895年,世家創始人艾斯特爾·雅寶(Estelle Arpels)與阿爾弗萊德·梵克(Alfred Van Cleef)的一段美好的姻緣。1906年,二人於巴黎中心地段的芳登廣場22號,开設首間Van Cleef & Arpels梵克雅寶精品店。數十年間,世家於全球奠定了其高級珠寶翹楚的顯赫地位,其經典作品與設計包括:如Alhambra四葉幸運系列、Zip項鏈以及Mystery Set隱密式鑲嵌工藝。世家以寶石造詣與精湛技藝,不斷創作出無數觸動心靈、如夢境般醉人的珠寶和腕表系列。今天,世家始終忠於自己融合詩意、典雅、創意和藝術美感的獨特風格,無論是以高級定制時裝、大自然、舞蹈,還是想象力爲靈感泉源,世家總是以歷久彌新的美與和諧不斷令世人沉醉於高級珠寶與腕表的迷人世界裏。

Van Cleef & Arpels梵克雅寶始終秉持傳承精湛工藝的使命,將其視爲珍而重之的核心價值。基於此,世家於2012年成立L’ÉCOLE珠寶藝術中心,旨在通過豐富的課程、講座、展覽和出版物,與普羅大衆分享珠寶文化。

標題:Van Cleef & Arpels梵克雅寶致敬métiers d’art大師工藝,以琺琅藝術升華腕上奇珍

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。